A Constituição Federal de 1988 dispõe sobre a impossibilidade de a lei excluir lesão ou ameaça a direito da apreciação do Poder Judiciário (art. 5º, inciso XXXV) e da razoável duração dos processos judiciais e administrativos (art. 5º, inciso LXXVIII, incluído pela Emenda Constitucional nº 45 de 2004).

Por sua vez, o Código de Processo Civil, em seu art. 8º, diz que o juiz atenderá aos fins sociais, sendo resguardada e garantida a dignidade da pessoa humana, além da proporcionalidade, razoabilidade, legalidade, publicidade e eficiência.

Em razão disso, o Poder Judiciário, nos últimos anos, vem se atualizando com mecanismos e ferramentas tecnológicas para buscar a efetivação de tais garantias, o que se deu em especial com a criação da “Justiça 4.0”, que tem o objetivo de desenvolver as plataformas digitais do poder judiciário, da sinapses/inteligência artificial, a Codex, o balcão virtual, o Juízo 100% digital, os núcleos de justiça 4.0, o Sniper e o domicílio judicial eletrônico.1

Observa-se que a Agenda 2030 da Organização das Nações Unidas (ONU) estipula dezessete Objetivos de Desenvolvimento Sustentável (ODS), os quais são estudados pelo Comitê Interinstitucional criado pelo Conselho Nacional de Justiça (CNJ) através da Portaria nº 133, de 28 de setembro de 2018. Dentre os objetivos elencados, destaca-se que cabe aos países signatários a promoção de sociedades pacíficas e inclusivas em vista de um desenvolvimento sustentável, sendo necessário que tais países proporcionem o acesso à justiça, a fim de construir instituições eficazes, responsáveis e inclusivas.2

Para a efetivação das garantias constitucionais e dos objetivos previstos na Agenda 2030 da ONU, os tribunais brasileiros se utilizam da inteligência artificial, a partir do que são desenvolvidas e implementadas ferramentas que buscam auxiliar no acesso à justiça e na prestação do direito. É notório, conforme relatório da ‘Justiça em Números’ divulgado pelo CNJ em 2023, que há um alto número de processos pendentes de julgamento no Brasil, de modo que o Poder Judiciário brasileiro observa na justiça digital e em ferramentas de inteligência artificial uma possibilidade de desafogamento dos processos aguardando julgamento.3

Nesse contexto, destaca-se a atuação do Conselho Nacional de Justiça (CNJ) que, desde que criado pela Emenda Constitucional nº 45, de dezembro de 2004, desempenha papel crucial na implementação da justiça digital no Brasil e no desenvolvimento de mecanismos de inteligência artificial. Dentre suas diversas resoluções sobre o tema, aponta-se a Resolução nº 332, de 21 de agosto de 2020, que dispôs sobre a utilização da inteligência artificial no âmbito dos tribunais brasileiros, a qual será detalhada abaixo.

Considerações gerais sobre inteligência artificial e outros termos pertinentes ao tema

De início, é preciso conceituar o que se entende por inteligência artificial. Contudo, faz-se necessário apontar, conforme detalhado por Tarcisio Teixeira, que há certa dificuldade quanto à definição deste termo.

O uso da terminologia “inteligência” tornou-se usual e mantém-se desde então, mas ao longo do tempo outras definições para inteligência artificial começaram a surgir, e hoje não existe apenas uma definição completa, mas várias definições que se completam. (…) Ou seja, inteligência artificial pode ser compreendida como conjunto de instruções que possibilitam que as máquinas executem tarefas que são características da inteligência humana, tais como planejamento, compreensão de linguagem, aprendizagem.4

Feita essa consideração, pode-se observar que S. Tavares-Pereira define inteligência artificial como:

toda aquela que, tentando simular algum processo cognitivo de sistemas psíquicos, está baseada: (i) em técnica de aprendizado automático, em que um algoritmo aprendiz capta as regras de tratamento das entradas diretamente de dados ou, então, (ii) embora com codificação tradicional, o algoritmo esteja baseado na aplicação de alguma lógica especial, não binária, como a lógica paraconsistente, por exemplo. Tais agentes de software inteligentes indicam a presença, em algum grau, de inteligência artificial na atividade processada por computadores.5

Com base nessa definição, é preciso realizar uma diferenciação deste conceito com o de algoritmo, o que, também nas palavras do autor S. Tavares-Pereira, diz respeito “a sequência de pequenas tarefas que o computador deve realizar organicamente, para produzir um resultado, expressa em qualquer linguagem simbólica”.6

Ainda, é necessário ressaltar que o funcionamento da IA resulta da base de dados utilizada, de modo que se faz necessário entender o que se entende por Machine Learning (ML) e Deep Learning (DL). Conforme ensina Tarcisio Teixeira, enquanto o primeiro corresponde à “utilização de algoritmos para coleta de dados e aprendizado com base nesses dados para que então a máquina desenvolva a habilidade de realizar determinada tarefa”, o segundo é subdivisão do primeiro, sendo que neste é permitido que a máquina aprenda dados complexos, sem que se saiba o caminho por ela percorrido.7

Observa-se que o Machine Learning (ML), também conhecido como aprendizado de máquina, pode ser classificado em aprendizagem supervisionada e não supervisionada. Sobre o assunto, escrevem Camila Rioja Arantes e Renato Opice Blum no livro “Advocia 4.0”, de coordenação de Viviane Nóbrega Maldonado:

- Aprendizagem Supervisionada: O modelo é treinado sobre um conjunto de dados predefinido – e geralmente bastante volumoso -, com algum tipo de classificação prévia e cujo resultado é “conhecido”. Exemplo: em um conjunto de dados bancários, por meio de um modelo, é possível determinar se alguém está habilitado ou não a receber empréstimos;

- Aprendizagem Não Supervisionada: O modelo pode automaticamente encontrar padrões e relações em um conjunto de dados com pouco ou nenhuma classificação. Exemplo: mineração de textos de e-mail para fins de document review.8

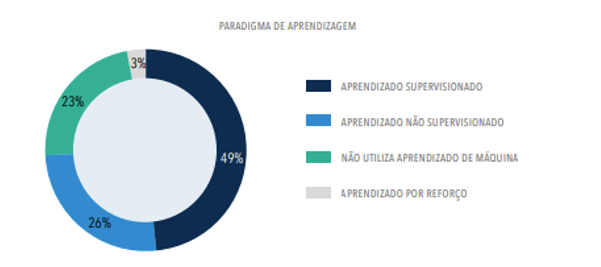

Para ilustrar, é necessário pontuar que, em um mapeamento realizado pela Fundação Getúlio Vargas (FGV), no Centro de Inovação, Administração e Pesquisa do Judiciário, coordenado pelo Min. Luis Felipe Salomão, verificou-se que há ferramentas mapeadas em grande parte dos tribunais brasileiros, sendo 49% referente ao paradigma de aprendizado supervisionado, 26% de aprendizado não supervisionado, 23% que não se utilizam de nenhum aprendizado de máquina e 3% de aprendizado por reforço.9

Figura 1 – Gráfico de paradigma de aprendizagem

Fonte: Relatório FGV (2022)

Com relação ao aprendizado por reforço, isso diz respeito à possibilidade, conforme explica Leonardo Roscoe Bessa e Ana Luisa Tarter Nunes, da máquina ser “instruída com um mecanismo de recompensa para o alcance de um resultado informado como correto e/ou uma desaprovação quando o resultado não for o almejado”, de modo que, por fim, é necessário concluir que IA não se confunde com automação.10

Sendo assim, observa-se que há diversos conceitos técnicos atinentes aos temas que precisam ser considerados, especialmente quando se trata de utilização da inteligência artificial pelos tribunais, uma vez que tais definições auxiliam os advogados e operadores do direito a entenderem as ferramentas desenvolvidas ou em desenvolvimento pelo Poder Judiciário.

Resolução nº 332, de 21 de agosto de 2020

O contexto atual, em especial diante dos inúmeros processos em trâmite nos tribunais brasileiros, exige que o Poder Judiciário se atualize quanto aos mecanismos de inteligência artificial, de modo que o CNJ – considerando sua competência para gerir a administração pública (art. 103- B, § 4º, inciso II, da CF) – editou a Resolução nº 332, de 21 de agosto de 2020, para dispor sobre a sua utilização no âmbito dos tribunais brasileiros, considerando a ética, transparência e governança.

Para justificar a edição desta Resolução, foi considerado que a Inteligência Artificial pode contribuir com a agilidade processual e auxiliar na coerência de decisões, havendo a necessidade de se observar os Direitos Fundamentais e, consequentemente, de garantir a igualdade e a não discriminação. Ainda, considerou-se que devem ser utilizados dados seguros, sendo também disposto sobre a necessidade de proteção do usuário.

Inicialmente, a Resolução nº 332 do CNJ trouxe disposições gerais em seu Capítulo I, tratando de seis conceitos principais, quais sejam: (i) algoritmo (definido como a “sequência finita de instruções executadas por um programa de computador), (ii) modelo de IA (“conjunto de dados e algoritmos computacionais, concebidos a partir de modelos matemáticos”), (iii) Sinapses (solução computacional que, dentre outras atividades, tem como função de auditar modelos de IA), (iv) usuário (pessoa, interna ou externa, que se utiliza do “sistema inteligente e que tem direito ao seu controle”, (v) usuário interno (aquele que é “membro, servidor ou colaborador do Poder Judiciário que desenvolva ou utilize o sistema inteligente”) e (vi) usuário externo (jurisdicionados, como advogados e membros do MP, que se utilizem e tenham contato com os programas de IA do Poder Judiciário).

A partir destas definições, referida Resolução trata, em seu segundo capítulo, do o respeito aos Direitos Fundamentais, o que, nos termos do art. 4º, deve ser considerado no desenvolvimento, na implantação e na utilização da IA pelo Poder Judiciário brasileiro (Capítulo II). A partir disso, busca-se garantir a igualdade de tratamento aos casos iguais e as cautelas quanto aos dados pessoais sensíveis, que devem considerados tal como definidos na Lei Geral de Proteção de Dados (LGPD), conforme trazido pela própria Resolução nº 332.

Na sequência, a Resolução nº 332 do CNJ trata sobre a não discriminação (Capítulo III), o que foi feito nos seguintes termos:

Art. 7º As decisões judiciais apoiadas em ferramentas de Inteligência Artificial devem preservar a igualdade, a não discriminação, a pluralidade e a solidariedade, auxiliando no julgamento justo, com criação de condições que visem eliminar ou minimizar a opressão, a marginalização do ser humano e os erros de julgamento decorrentes de preconceitos.

Nos três parágrafos do citado art. 7º, complementa-se que é necessário um controle das ferramentas em desenvolvimento, inclusive antes do modelo ser posto em produção. Uma vez que se verifique viés discriminatório, é prevista a possibilidade de serem adotadas medidas coercitivas e a descontinuidade do modelo desenvolvido, registrando-se o projeto e as razões de sua não utilização.

No Capítulo IV, define-se transparência, que abrange (i) divulgação responsável, em especial em razão de tais ferramentas serem aplicadas e terem portanto acesso a dados judiciais), (ii) a necessidade de “indicação dos objetivos e resultados pretendidos pelo uso do modelo de Inteligência Artificial”, (iii) “documentação dos riscos identificados e indicação dos instrumentos de segurança da informação e controle para seu enfrentamento”, (iv) “possibilidade de identificação do motivo em caso de dano causado pela ferramenta de Inteligência Artificial”, (v) apresentação dos mecanismos de auditoria e certificação de boas práticas e (vi) do “fornecimento de explicação satisfatória e passível de auditoria por autoridade humana”.

Por conseguinte, a Resolução nº 332 do CNJ se destina a dispor sobre governança e qualidade, conforme seu Capítulo V. Neste ponto, determina que os tribunais brasileiros informem ao CNJ o uso da Inteligência Artificial desde o início das pesquisas, além de que estes promovam esforços para atuação comunitária e depositem no Sinapses os modelos de IA. Ainda no Capítulo V, foi previsto que o CNJ publicará a relação de modelos de IA desenvolvidos/utilizados pelos tribunais brasileiros em seu site da Internet, e que tais ferramentas devem ter interface com outros sistemas, o que se dará a partir do padrão de interface de programação de aplicativos (API) a ser estabelecido pelo CNJ.

Logo após, o Capítulo VI versa sobre a segurança a partir do que foi previsto sobre a necessidade de modelos de IA se utilizarem de fontes seguras e que todos os dados devem ser protegidos, em especial de riscos quanto à destruição, modificação, extravio e transmissões não autorizadas, sendo necessário que seja mantido um “detaset” (cópia) para cada modelo desenvolvido. Para tal, a Resolução nº 332 do CNJ dispõe que o armazenamento e a execução dos modelos de Inteligência Artificial deverão ocorrer em ambientes aderentes a padrões consolidados de segurança da informação (art. 16).

No capítulo VII, referida Resolução versa sobre o controle do usuário, sendo resguardado que usuários externos sejam informados sobre a utilização de sistema inteligente nos serviços a eles prestados. Adicionalmente, foi previsto que:

Art. 19. Os sistemas computacionais que utilizem modelos de Inteligência Artificial como ferramenta auxiliar para a elaboração de decisão judicial observarão, como critério preponderante para definir a técnica utilizada, a explicação dos passos que conduziram ao resultado.

Parágrafo único. Os sistemas computacionais com atuação indicada no caput deste artigo deverão permitir a supervisão do magistrado competente.

Em seguida, a Resolução nº 332 do CNJ busca dispor sobre a pesquisa, o desenvolvimento e a implementação de serviços de IA (Capítulo VIII). Nesse sentido, determina-se sobre a composição de equipes para tal fim, o que deve observar “a diversidade em seu mais amplo espectro, incluindo gênero, raça, etnia, cor, orientação sexual, pessoas com deficiência, geração e demais características individuais”.

Tais equipes também deverão ser formadas a partir de um caráter interdisciplinar, sendo vedado o desrespeito a dignidade e a liberdade, a promoção de atividades de risco e a subordinação “das investigações a sectarismo capaz de direcionar o curso da pesquisa ou seus resultados” (art. 21 da Resolução nº 332 do CNJ). Ainda, é feita a ressalva de que não se estimula a utilização de modelos de IA em matéria penal, em especial quanto possíveis ferramentas de reincidência penal.

Considerando o previsto até então, referida Resolução passa, no Capítulo IX, a dispor sobre a prestação de contas e eventuais responsabilizações, no sentido de que:

Art. 25. Qualquer solução computacional do Poder Judiciário que utilizar modelos de Inteligência Artificial deverá assegurar total transparência na prestação de contas, com o fim de garantir o impacto positivo para os usuários finais e para a sociedade. Parágrafo único. A prestação de contas compreenderá:

I – os nomes dos responsáveis pela execução das ações e pela prestação de contas;

II – os custos envolvidos na pesquisa, desenvolvimento, implantação, comunicação e treinamento;

III – a existência de ações de colaboração e cooperação entre os agentes do setor público ou desses com a iniciativa privada ou a sociedade civil;

IV – os resultados pretendidos e os que foram efetivamente alcançados;

V – a demonstração de efetiva publicidade quanto à natureza do serviço oferecido, técnicas utilizadas, desempenho do sistema e riscos de erros.

Com base nisso foi disposto que, caso desenvolvida determinada ferramenta em desconformidade com os princípios/regras da Resolução nº 332 do CNJ, poderá haver a devida apuração do ocorrido e eventual punição dos responsáveis (art. 26), e que há um dever dos órgãos do Poder Judiciário de informar ao CNJ os eventos adversos de uso da IA (art. 27).

Por meio de disposições finais, inseridas no Capítulo X da Resolução nº 332 do CNJ, é previsto que pode haver cooperação técnica entre os órgãos do Poder Judiciários e instituições públicas ou privadas, ou junto à própria sociedade civil (art. 28). Ao fim, é esclarecido que as normas desta resolução não excluem outras aplicáveis aos casos em concretos (art. 29) e que tais disposições devem ser aplicadas de imediato, inclusive para programas já implementados e aperfeiçoados (art. 30).

Ferramentas mapeadas no Poder Judiciário brasileiro

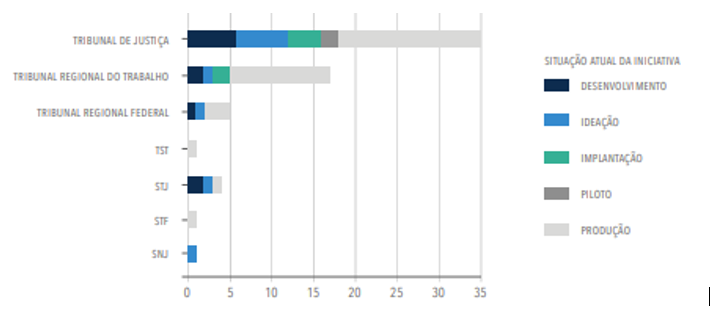

Conforme esclarecido acima, o Centro de Inovação, Administração e Pesquisa do Judiciário da FGV, coordenado pelo Min. Luis Felipe Salomão, mapeou diversas iniciativas de ferramentas de IA nos tribunais brasileiros. Em síntese, foram localizadas 20 ferramentas no Centro-oeste, 13 no Sul, 12 no Sudeste, 10 no Nordeste e 9 no Norte. Com relação à quantidade de iniciativas por tribunal e por situação, observou-se o seguinte gráfico.11

Figura 2 – Quantidade de iniciativas por tribunal e por situação

Dentre tais ferramentas, destacam-se, diante de um contexto de Cortes Especiais e com abrangência nacional, aquelas mapeadas no STF e no STJ.

No STF há a iniciativa “Victor”, que é utilizada desde 2017, sendo uma ferramenta de aprendizado supervisionado que busca solucionar questões de indicação de temas de repercussão geral no âmbito do STF, principalmente quanto à agrupamento de processos por similaridade. Seu funcionamento se dá por meio da submissão ao modelo dos autos dos processos remetidos ao STF, utilizando-se de uma base de dados com cerca de 10 milhões de documentos.12

É necessário registrar que hoje também é utilizado pelo STF o “RAFA 2030”, uma feramente de IA criada para ajudar na classificação dos processos de acordo com os Objetivos de Desenvolvimento Sustentável da Agenda 2030, reforçando a utilização de tais mecanismos para fomentar o acesso à justiça e efetivar outras garantias constitucionais.13

No STJ destaca-se a iniciativa “Athos”, que busca solicitar questões de (i) triangulação de jurisprudência, (ii) identificação de temas repetitivos e (iii) monitoramento de temas. Com isso, a descrição do funcionamento da iniciativa é feita utilizando-se de um corpus de 328 mil documentos extraídos da jurisprudência do STJ, o modelo foi treinado para a geração de representações vetoriais de documentos do escopo jurídico. Estas representações vetoriais são, então, armazenadas e utilizadas para verificação de similaridade semântica entre os documentos. O recurso permite busca por grau de similaridade e até mesmo a formação automática de grupos de documentos, bem como o monitoramento em tempo real de processos com peças semelhantes aos paradigmas apontados. A solução está completamente integrada ao sistema de acompanhamento processual da Corte, e hoje conta com aproximadamente 10 milhões de peças processuais vetorizadas.14

Ainda mapeou-se, no STJ, a iniciativa “DataJud – Identificação dos assuntos TUA/CNJ”, que, ao se utilizar da codificação da Tabela única de Assunto do CNJ (TUA/CNJ), tem como objetivo identificar matérias tratadas nos feitos remetidos ao Tribunal, a fim de que seja alimentado o DataJud, além da “Indexação de Peças Processuais em Processos Originários” que busca “otimizar a identificação e indexação das peças processuais nos autos originários” e da “Identificação de Fundamentos de Inadmissão do REsp”.15

Ademais, foi mapeado que estava em produção no também no TST a ferramenta “Bem-te-vi”, que busca servir como um apoio na gestão do acervo de gabinetes, principalmente relacionado a uma atividade de triagem processual, ressaltando-se também que está em desenvolvimento um modelo de agrupamento de processos semelhantes.16

Com tais exemplos, observa-se que a inteligência artificial está sendo utilizada por grande parte do Poder Judiciário brasileiro, não se podendo observar que estes também estão disponíveis em outros órgãos. Por exemplo, o TCE do Amazonas lançou uma versão piloto de sua ferramenta “Chat-TCE”, que serve como um assistente que se utiliza da base de dados referente aos processos julgados para auxiliar servidos em novas instruções processuais, o que demonstra uma tendência de que sejam utilizadas tais ferramentas.17

Conclusão

A partir do exposto, verifica-se, conforme anteriormente apontado, que a Resolução do CNJ nº 332, de 21 de janeiro de 2020 aponta diretrizes para a utilização e implementação da inteligência artificial no Poder Judiciário, abarcando, dentre outros assuntos, o respeito aos direitos fundamentais, a não discriminação e a divulgação responsável dos dados.

Com base nisso, a inteligência artificial vem sendo implantada pelo Poder Judiciário brasileiro, o que se ilustrou pelos exemplos abordados no presente trabalho, especialmente em razão da pesquisa realizada pela FGV no Centro de Inovação, Administração e Pesquisa do Judiciário, coordenada pelo Min. Luis Felipe Salomão.

Nesse contexto, é possível concluir que a utilização da IA serve como um aliado do Judiciário para efetivação de garantias constitucionais e para cumprimento da Agenda 2030 da ONU, sendo, consequentemente, uma forma utilizada para garantir o acesso à justiça, a economia processual e a razoável duração do processo.

Contudo, é necessário registrar que o desenvolvimento e a utilização da inteligência artificial devem ser constantemente atualizados, de forma que a Resolução hoje vigente precisará acompanhar eventuais modernizações, bem como para garantir a segurança dos mecanismos de IA utilizadas pelo Poder Judiciário.

- BRAGANÇA, Fernanda. O progresso da justiça digital no brasil: da urna eletrônica ao programa 4.0. Revista Eletrônica De Direito Processual, v. 24, n. 3, p. 211-233, 2023. Disponível em: https://doi.org/10.12957/redp.2023.65781. Acesso em: 20 jan. 2024. ↩︎

- ORGANIZAÇÃO DAS NAÇÕES UNIDAS. Agenda 2030 para o Desenvolvimento Sustentável. 2015. Disponível em: https://brasil.un.org/pt-br/91863-agenda-2030-para-o-desenvolvimento-sustent%C3%A1vel. Acesso em: 24 mar. 2024. ↩︎

- CONSELHO NACIONAL DE JUSTIÇA. Relatório Justiça em Números. Brasília, DF: CNJ, 2023. Disponível em: https://www.cnj.jus.br/wp-content/uploads/2023/09/justica-em-numeros-2023-010923.pdf. Acesso em: 20 jan. 2024. ↩︎

- TEIXEIRA, Tarcisio. Direito Digital e Processo Eletrônico. 7 ed. São Paulo: SaraivaJur, 2023. ↩︎

- TAVARES-PEREIRA, S. Machine Learning nas decisões: o uso jurídico dos algoritmos aprendizes. Florianópolis: ArteSam Editora, 2021. ↩︎

- TAVARES-PEREIRA, S. Machine Learning nas decisões: o uso jurídico dos algoritmos aprendizes. Florianópolis: ArteSam Editora, 2021. ↩︎

- TEIXEIRA, Tarcisio. Direito Digital e Processo Eletrônico. 7 ed. São Paulo: SaraivaJur, 2023. ↩︎

- MALDONADO, Viviane Nóbrega; FEIGELSON, Bruno (Coord.). Advocacia 4.0. São Paulo: Thomson Reuters Brasil, 2019. ↩︎

- FUNDAÇÃO GETÚLIO VARGAS. Inteligência artificial: tecnologia Aplicada à Gestão dos Conflitos no Âmbito do Poder Judiciário. Rio de Janeiro, 2020. Disponível em: https://conhecimento.fgv.br/sites/default/files/2022-08/publicacoes/relatorio_ia_2fase.pdf. Acesso em: 18 fev. 2024. ↩︎

- BESSA, Leonardo Roscoe; NUNES, Ana Luisa Tarter. Inteligência artificial (IA) e danos ao consumidor. Revista dos Tribunais, Revista de Direito do Consumidor, vol. 150/2023, p. 15 – 48, 2023. ↩︎

- FUNDAÇÃO GETÚLIO VARGAS. Inteligência artificial: tecnologia Aplicada à Gestão dos Conflitos no Âmbito do Poder Judiciário. Rio de Janeiro, 2020. Disponível em: https://conhecimento.fgv.br/sites/default/files/2022-08/publicacoes/relatorio_ia_2fase.pdf. Acesso em: 18 fev. 2024. ↩︎

- FUNDAÇÃO GETÚLIO VARGAS. Inteligência artificial: tecnologia Aplicada à Gestão dos Conflitos no Âmbito do Poder Judiciário. Rio de Janeiro, 2020. Disponível em: https://conhecimento.fgv.br/sites/default/files/2022-08/publicacoes/relatorio_ia_2fase.pdf. Acesso em: 18 fev. 2024. ↩︎

- STF finaliza testes de nova ferramenta de Inteligência Artificial. STF, 2023. Disponível em: https://portal.stf.jus.br/noticias/verNoticiaDetalhe.asp?idConteudo=507120&ori=1#:~:text=Atualmente%2C%20o%20STF%20opera%20dois,com%20os%20Objetivos%20de%20Desenvolvimento. Acesso em: 18 fev. 2024. ↩︎

- FUNDAÇÃO GETÚLIO VARGAS. Inteligência artificial: tecnologia Aplicada à Gestão dos Conflitos no Âmbito do Poder Judiciário. Rio de Janeiro, 2020. Disponível em: https://conhecimento.fgv.br/sites/default/files/2022-08/publicacoes/relatorio_ia_2fase.pdf. Acesso em: 18 fev. 2024. ↩︎

- FUNDAÇÃO GETÚLIO VARGAS. Inteligência artificial: tecnologia Aplicada à Gestão dos Conflitos no Âmbito do Poder Judiciário. Rio de Janeiro, 2020. Disponível em: https://conhecimento.fgv.br/sites/default/files/2022-08/publicacoes/relatorio_ia_2fase.pdf. Acesso em: 18 fev. 2024. ↩︎

- FUNDAÇÃO GETÚLIO VARGAS. Inteligência artificial: tecnologia Aplicada à Gestão dos Conflitos no Âmbito do Poder Judiciário. Rio de Janeiro, 2020. Disponível em: https://conhecimento.fgv.br/sites/default/files/2022-08/publicacoes/relatorio_ia_2fase.pdf. Acesso em: 18 fev. 2024. ↩︎

- SOUSA, Pedro. TCE-AM promove integração entre setores para aperfeiçoar serviços. Tribunal de contas do Estado do Amazonas, 2024. Disponível em: https://www2.tce.am.gov.br/?p=68790. Acesso em: 18 fev. 2024. ↩︎